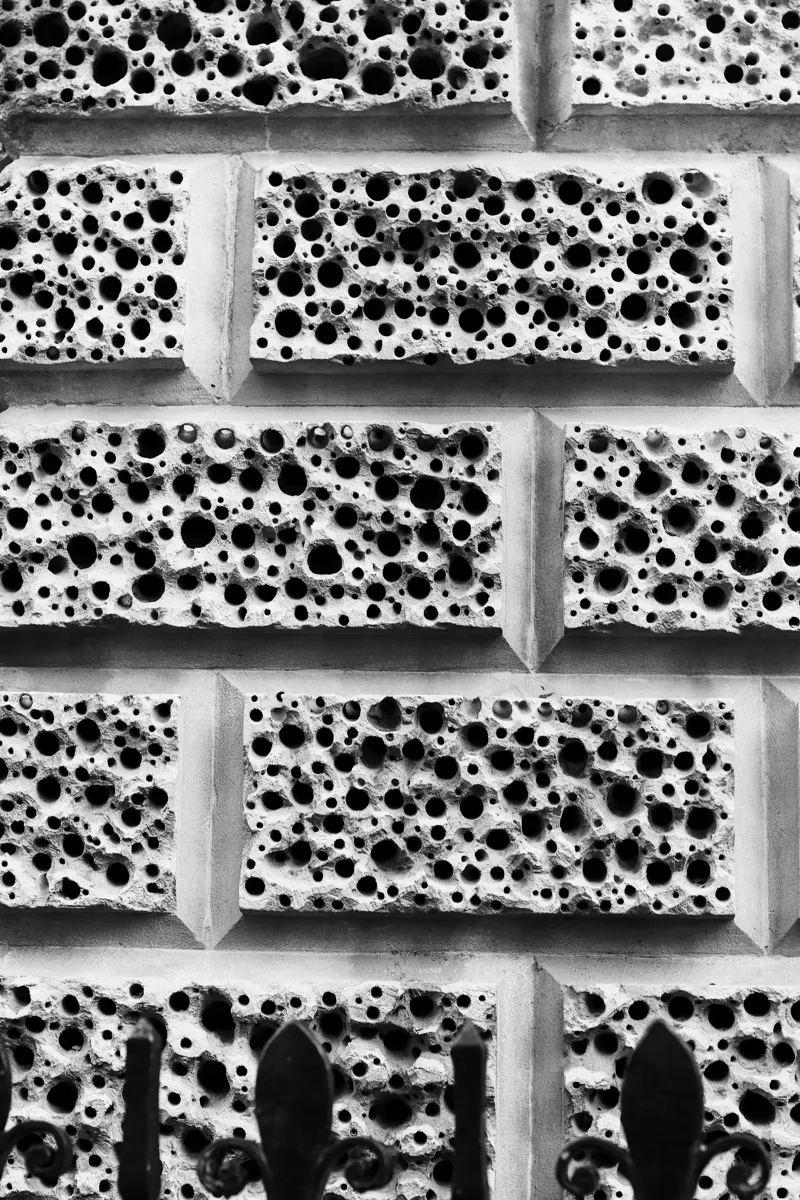

Stack poreuse

Le vibe coding accélère la production. Il accélère aussi les risques.

L'IA génère du code plus vite que les processus de revue ne peuvent suivre. Ce n'est pas un problème de compétence — c'est un problème de rythme. Les dépendances transitives échappent aux audits manuels, le code généré reproduit des patterns vulnérables, et la supply chain logicielle s'élargit sans visibilité.

Chaque ligne de code non auditée est une brèche potentielle. L'enjeu n'est pas de ralentir l'IA — c'est d'outiller la chaîne pour que la vitesse ne se fasse pas au détriment de la sécurité.